1. 引言

卫星遥感为地理空间大数据贡献了海量信息流,已成为大数据产业的基础设施。中国卫星遥感技术起源于20世纪80年代,在资源调查、环境监测、灾害预测、气象预报、海洋监测等领域得到了广泛应用,推动遥感技术向高时空分辨率、智能感知等方向发展。据统计2030年前我国遥感卫星有望超过800颗,将显著提升遥感数据获取能力和时间分辨率,也将对星地通讯带宽和数据处理效率产生巨大压力,因此要研究能够有效获取关键信息的遥感技术手段,利用增量数据更新替代大面积普查。

这一思路是将地表视为时刻变化但大部分区域不变化,利用数据中的现势信息,将时域运动和变化信息表征为对象和知识,配合在轨处理完成关键动目标信息提取。将"数据"转换为"信息",满足"现势数据、即时传输"的应用要求,将大大提升遥感信息的获取和利用效率。

针对上述问题,学者和工程人员开展了丰富的探索性研究工作。QuickBird、WorldView等卫星多谱段传感器间存在时差,全色和多光谱探测器的焦平面存在一定距离,针对相同地表区域成像时存在约0.2s左右的延迟,Zhang等利用此时差进行车辆运动目标的检测和速度估计,但时差较小不利于提取慢速动目标。SkySat、吉林一号等卫星视频数据解决了观测时差问题,适合开展动目标检测,但凝视成像限制了卫星的成像范围。

此外,同轨道多角度成像也能提供具有时差的图像,如WorldView-1通过俯仰机动在一次过境对同一目标从不同角度获取约20次图像,国内高分多模遥感卫星也可实现多角度立体成像,资源三号卫星(ZY-3)可以获取前视、正视、后视的不同视角影像,此类方式视场角差异较大,不利于动目标检测。

2. 双线阵推扫成像概念与特征

通过遥感卫星实现地面动态环境感知的过程,可参考自动驾驶高级驾驶辅助系统(Advanced Driver Assistance Systems, ADAS)实时感知动态目标的方式,采集地表时间维度动态信息或者情报,如反映事件、过程、系统或者对象动态变化的信息,从而实现动态感知。动态目标也可称为动目标,通过位置、速度、方向等动态信息可以确定和刻画动目标的状态。本文提出的双线阵推扫成像方法兼顾了大范围推扫和时序成像,在扩展数据的时间分辨率同时实现动目标运动信息的有效观测。

2.1 双线阵推扫成像原理

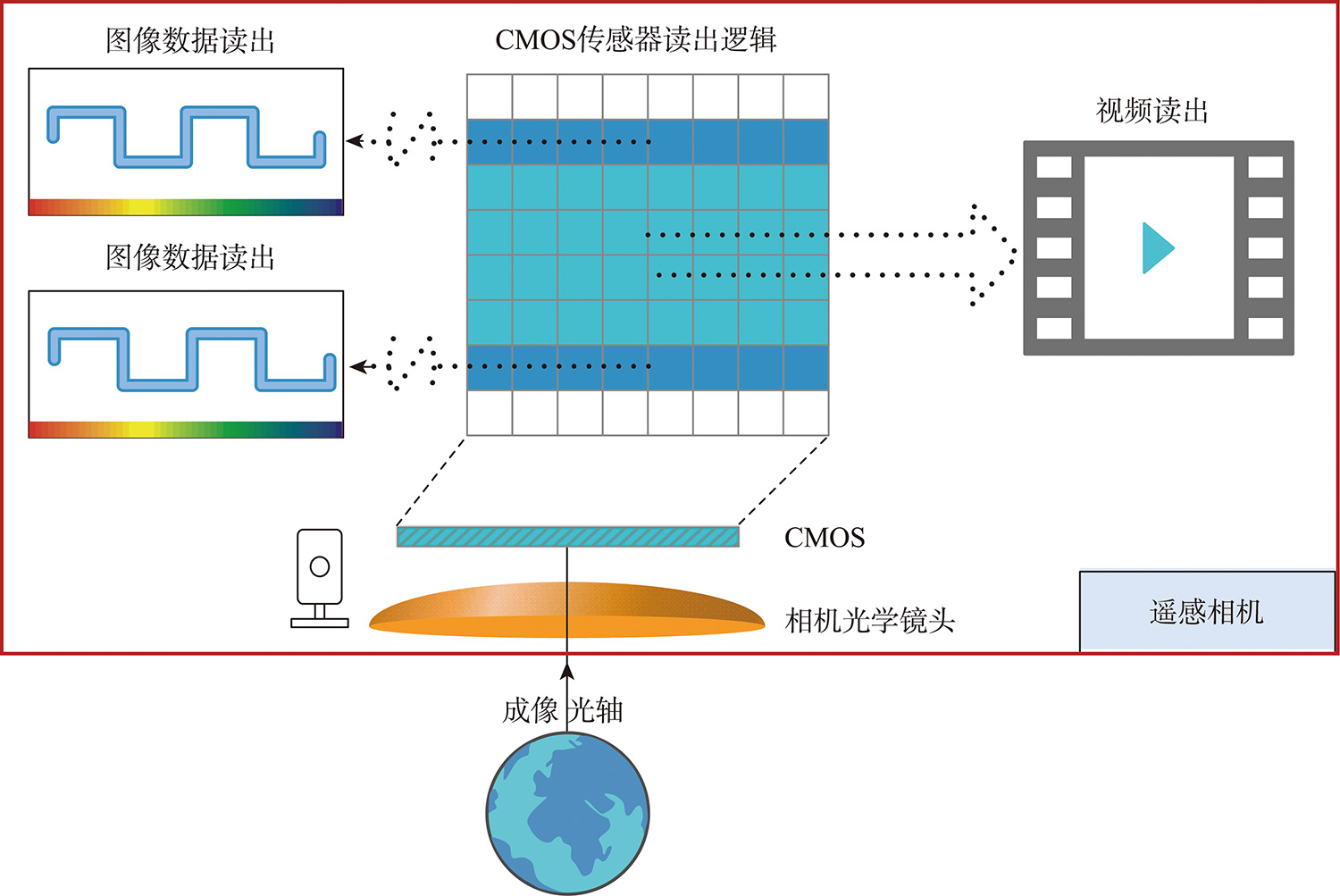

双线阵推扫成像的基础是成像传感器的多模态设计,通过面阵CMOS图像传感器实现多区域开窗模式,在驱动电路和像素电路之间架设行选地址译码器,地址译码器根据预制的程序,驱动特定行像素进行成像,从而实现传感器不同区域开窗,单次成像获取时差可控同谱双条带数据。在触发2个线阵开窗区域进行成像时,根据GPS秒脉冲信号同步对地表推扫成像,形成双条带图像,2个时刻的图像中对应起始行拥有相同的时间标签。

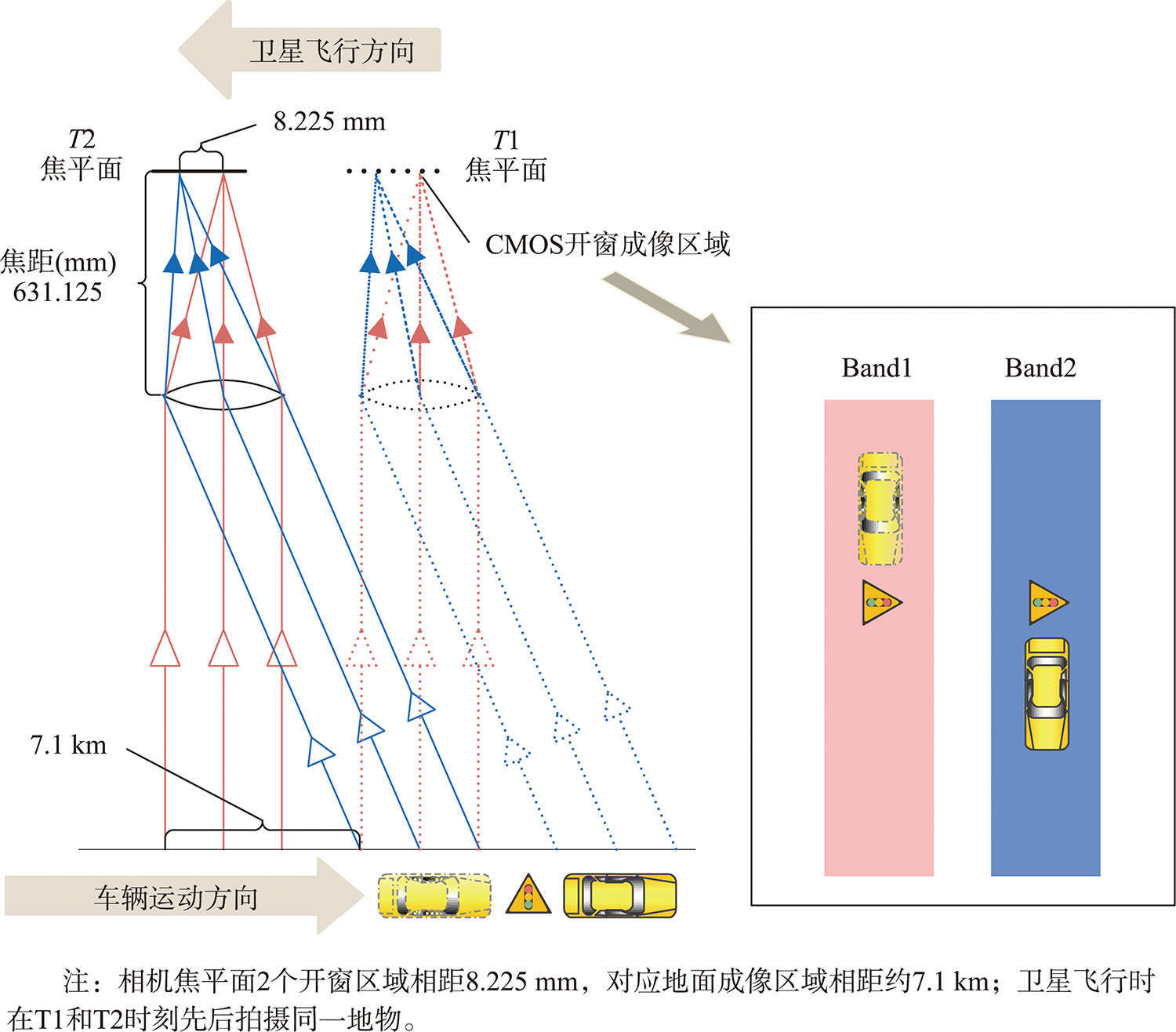

根据上述原理,在轨道高度、相机光学参数已知条件下,通过控制CMOS的行选择信号,利用不同区域开窗成像,从而实现对地面同一区域不同时间成像的控制逻辑。此原理可以通过如下计算过程进行描述和解释,采用相机光学镜头焦距、像元尺寸、传感器开窗区域像素行数间隔、卫星平台轨道高度、卫星相对地速、星下点位移等参数间的数学关系进行描述。通过传感器开窗区域行数间隔计算其物理距离,从而实现对星下点位移的计算,如式(1)和式(2)所示。

dH = (w × H) / f (2)

式中:w是双线阵之间开窗区域之间的距离即像平面距离/mm;Rnum是传感器双线阵之间的像素行数间隔;s表示像元尺寸/mm;dH是双线阵像点对应地面星下点的移动距离/km;H是轨道高度/km;f为光学镜头的焦距/mm。

2.2 动目标时空特性数学模型

真实世界中动目标和背景处在三维立体空间及一维时间的四维空间,在双线阵推扫成像获取的双条带图像中,动目标和背景投影到成像平面上则形成二维平面及一维时间的三维空间。为了表达动目标在图像背景中的位置和运动信息,需要分析动目标运动状态的时空特性数学模型,利用运动矢量、速度、方向、坐标等关键信息描述动目标参数。

3. 基于显著性区域建议的动目标检测方法

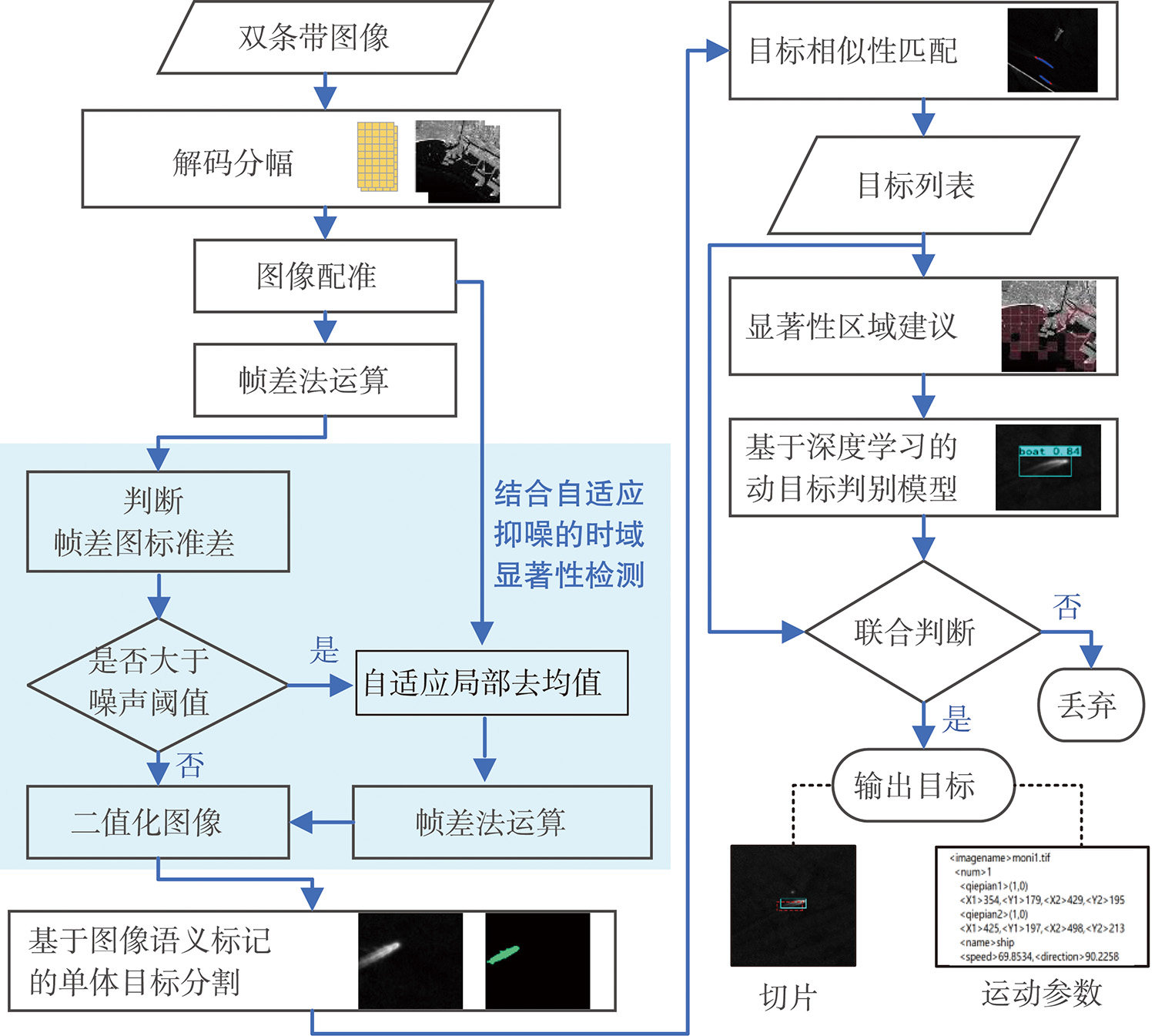

遥感图像数据量巨大,且存在占据几十个像素甚至十几个像素的小目标,特征信息的缺失导致检测精度下降。面对处理效率和算法性能的要求,本文根据双条带图像的特点,提出基于显著性区域建议的动目标检测方法,利用时域显著性检测获取动目标分布的显著性区域,并结合深度学习目标检测进行动目标判别抑制虚警,在双条带影像中筛选出动目标关键信息。

显著性区域建议是计算机视觉领域进行特征检测或目标检测时,常用的候选区域提取方法,通常采用频域和时域提取方法获取图像显著性特征,例如颜色、亮度、对比度和变化信息等。双线阵推扫成像获取的时序图像包含时域变化和运动信息,与时域显著性理论高度契合。因此,通过提取图像中2个时刻动目标的时域显著性,可以获取动目标检测结果。

4. 实验及结果分析

4.1 评价指标

为了评价本文算法优化效果,引入了召回率(Recall)、准确率(Accuracy)和虚警率(False Alarm)作为精度评价指标,算法总体耗时作为算法性能的评价指标。为了验证本文算法模块的有效性,设计了消融实验,按照模块划分设计了4项对比实验。

准确率 = TP / (TP + FP + FN) (23)

虚警率 = FP / (TP + FP) (24)

4.2 实验数据与计算环境

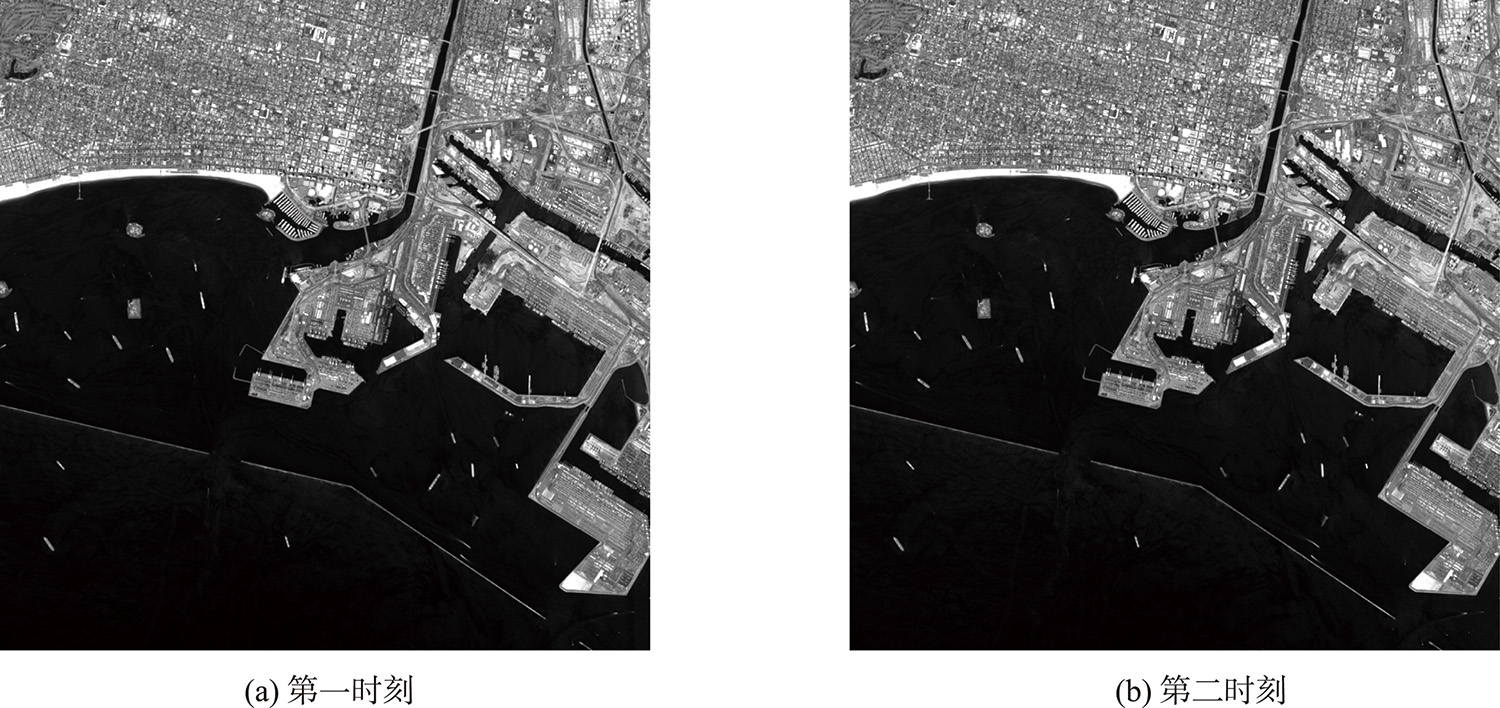

为验证本文方法的有效性,选择泰景四号01星在轨拍摄的双条带图像开展实验。实验环境为NVIDIA AGX Xavier开发板计算平台,开发板包含NVIDIA Volta架构的GPU、8核心ARM64CPU,提供512个CUDA核心和64个Tensor核心。实验数据拍摄区域为美国洛杉矶港,图像尺寸为5000像素×5000像素,包含较多小目标、暗弱目标,共有49个船舶目标,存在29个小型船舶动目标,其余20个为等待进港的静止船舶。

4.3 方法对比实验

本文方法对YOLOv5s网络进行小目标预测头优化以及稀疏剪枝训练,并对优化前后的网络进行了比较,结果如表1所示,在泰景四号01星采集的数据集上,本文模型YOLOv5s+mini+prune在各个指标上均取得理想结果。

| 模型 | mAP@0.5 | mAP@0.5:0.95 | FPS | 模型大小/MB | 参数量/个 |

|---|---|---|---|---|---|

| YOLOv5s | 0.926 | 0.493 | 25 | 14.1 | 7046599 |

| YOLOv5s+mini | 0.931 | 0.457 | 18 | 15.5 | 7192244 |

| YOLOv5s+mini+prune | 0.941 | 0.520 | 39 | 7.7 | 2101396 |

5. 结论与展望

5.1 结论

本文围绕大规模卫星遥感系统数据量大、动态信息观测手段少的问题,以利用光学遥感卫星实现 大范围实时动目标检测以及在轨智能处理为目标, 研究并创新了双线阵推扫成像模式和方法,实现了 单轨影像中时间维动态信息的获取,相比常规卫星 视频其成像范围更大,对比单条带推扫图像,其扩 展了影像在时间域的信息量。

针对大范围双条带图像中复杂背景下动目标 检测问题,提出基于显著性区域建议的动目标检测 方法,实现算法模型的高性能、轻量化。该方法将 时域动目标信息表征为区域建议的显著性指标,建 立基于图像语义标记的单体目标分割方法,通过目 标相似性匹配构建目标初始配对列表;为了解决算 法效率和轻量化的问题,利用配对列表中坐标确定 显著性区域,实现数据预筛选,减少中间数据量。 结合在轨处理计算资源约束,提出基于深度学习的 动目标判别模型,实现配对列表中动目标的有效判 别,降低虚警率。相较现有方法,通过单体目标分 割提升动目标轮廓和边界结构的完整性,优化了目 标匹配逻辑,消融实验中本文方法相较基准方法召 回率提升17.4%,同时目标检出数量从基准方法的 99对降低到38对,减少了61.6%,准确率得到提升; 算法执行效率从44.2 s减少到17.06 s,提升61.4%, 算法效率更优。

5.2 展望

当前局限

- 受目 视获取真实动目标先验知识的限制,模型检出的其 他目标中可能存在速度较慢的真实移动样本,但由 于目视无法分辨其运动状态,导致模型虚警率和准 确率指标存在一定的误差;

- 受样本数据集限制, 只完成了船舶和飞机两类目标的样本标注工作,后 续可针对更多类型样本开展模型训练和测试工作, 进一步优化基于深度学习的目标检测算法,研究具 备较强泛化能力的算法模型

未来方向

- 可应用研究成果 进一步开展地学领域应用研究,探索在洪涝评估、 冰凌检测、极端天气预警等场景的交叉融合研究