研究背景

随着智能遥感卫星系统的快速发展,通过星上在轨自主且智能的处理方式,直接获取所需的测绘产品,分发至用户,实现端到端的高效测绘遥感应用服务,展现出巨大的发展潜力和广阔的应用背景。

星上遥感影像智能解译作为智能遥感卫星系统的重要组成部分,在国内外多颗光学遥感卫星上得到了初步应用。但SAR作为智能遥感卫星系统中不可或缺的一部分,其星上智能解译却起步较晚且研究较少,在轨SAR影像船舶精确定位和识别则是其中的一项关键技术,并且在海上监视、海上贸易、海上救援和军事行动等领域具有广泛的应用。

传统检测方法

- 恒虚警率检测算法(CFAR)

- 局部Radon变换与峰值聚类决策的舰船尾迹检测算法

- 对于目标和背景对比度高的简单场景效果较好

- 检测速率低,复杂场景下存在大量虚警和漏警

深度学习检测方法

- 双阶段检测算法(Fast R-CNN, Faster R-CNN等)

- 单阶段检测算法(SSD, Yolo系列等)

- 双阶段算法计算量大、检测速率慢

- 单阶段算法检测速度快,更有利于实际应用

现有研究挑战

多尺度问题

各类船舶目标方向和尺度不同,在SAR影像中表现为不同像素数,小型船舶易与背景斑点噪声混淆

复杂背景干扰

海面上的小型岛屿、海岸附近的船坞等地物干扰,靠岸船舶与海岸融为一体等现象

硬件资源限制

星上的硬件资源有限,如何在有限资源下降低网络参数并保持检测速率和精度

研究方法

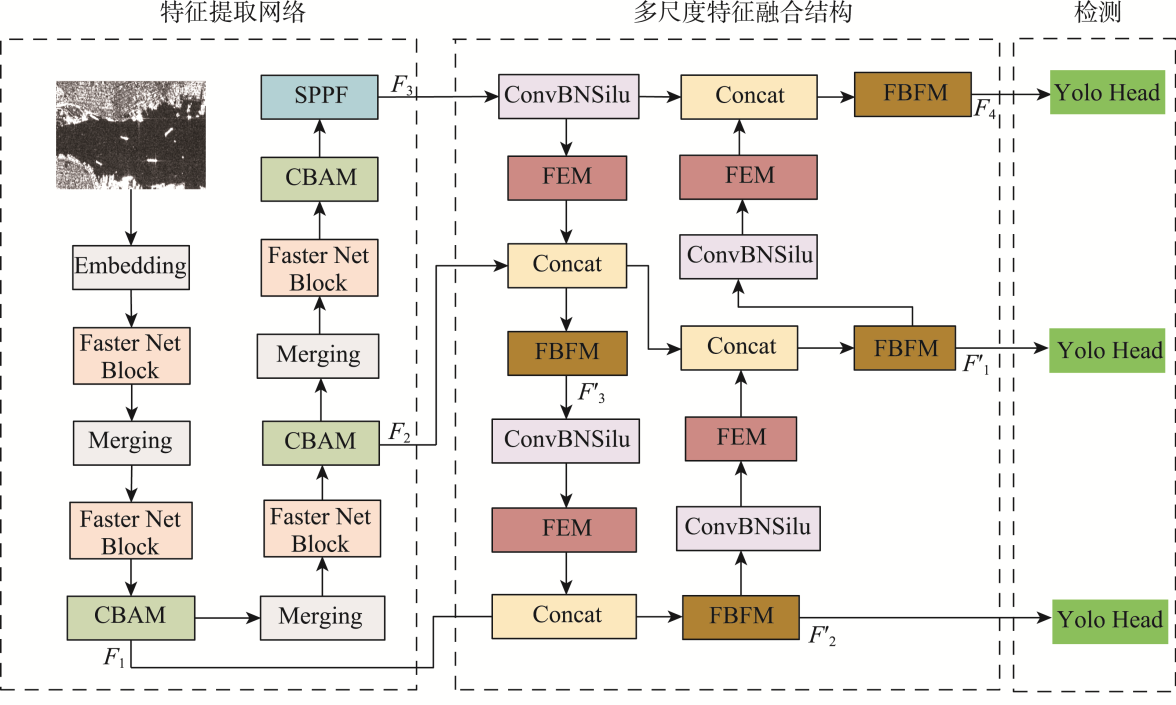

本文算法的基准方法选用Yolov5s,整体框架如图1所示。算法具体步骤包括:

主干网络特征提取

主干网络特征提取

特征增强

多尺度特征融合

特征检测

图1 本文SAR影像船舶检测算法整体框架

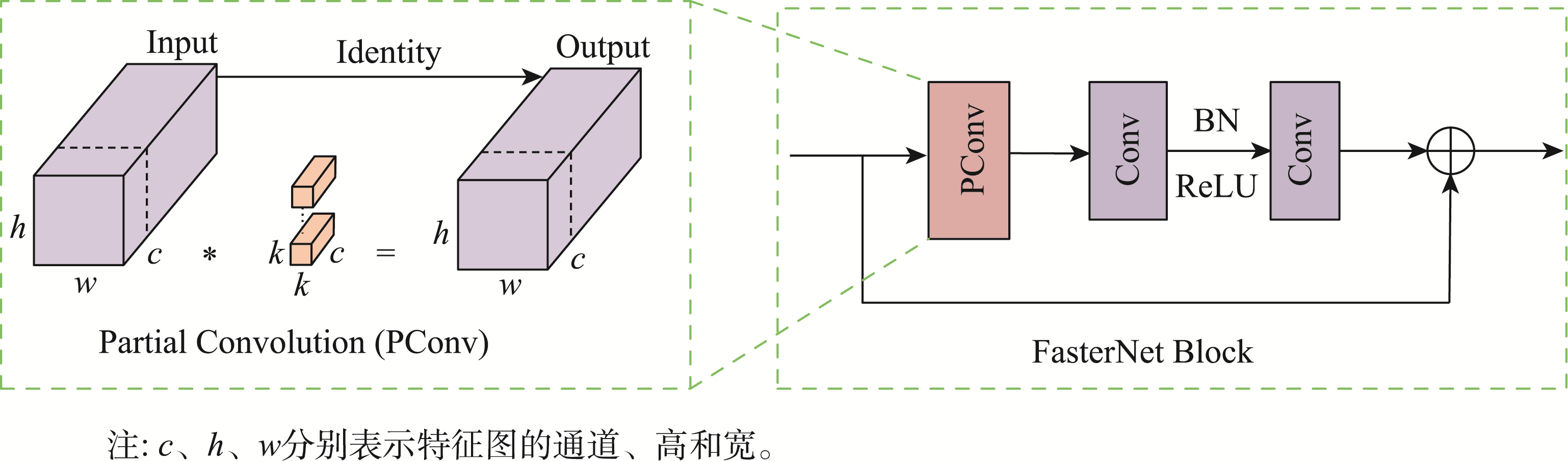

2.1 轻量级特征提取网络

本文选取轻量级卷积神经网络FasterNet作为主干网络。该网络具有结构简单,运行速度快,易部署在硬件的特点。其中网络主要分为4部分,第一个部分首先是一个编码的过程,其他部分是一个合并的过程,主要作用是下采样和增加通道数量,同时每个部分拥有若干个FasterNet Block模块。

图2 FasterNet Block结构

FasterNet模块由一个3×3的PConv和2个1×1的Conv,以及一个残差结构组成。其中PConv是在输入通道的一部分上应用常规Conv进行空间特征提取,并保持其余通道不变。

h×w×2c+k²×c² ≈ h×w×2c

PConv内存访问量仅为常规卷积的1/4,极大地提高了卷积计算速度,减少特征提取过程中的参与运算的参数量。

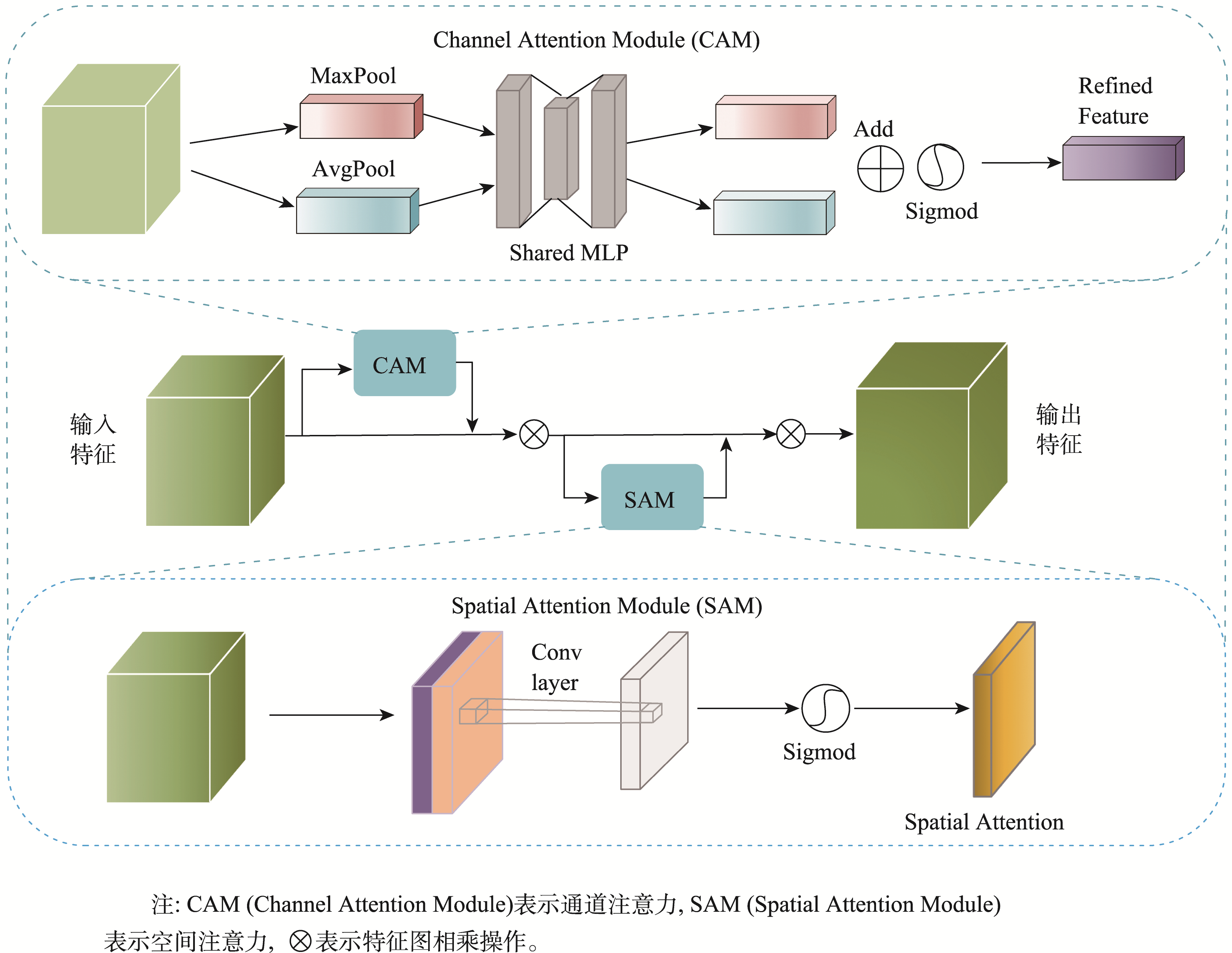

注意力机制(CBAM)

本文使用结合通道和空间维度信息的注意力机制(CBAM),结构如图3所示,CBAM是按照先通道后空间的顺序串联起来,它包含2个子模块,即通道注意力(CAM)和空间注意力模块(SAM)。

图3 CBAM网络结构

通道注意力(CAM)

将输入的特征图分别通过的最大池化层和平均池化层,然后将得到的2个特征图送到一个多层感知机(MLP)中处理,最后做加和以及激活操作输出特征

空间注意力(SAM)

分别通过基于通道的最大池化和平均池化,拼接这2个特征,然后做一个卷积的降维操作,最后经过激活输出特征

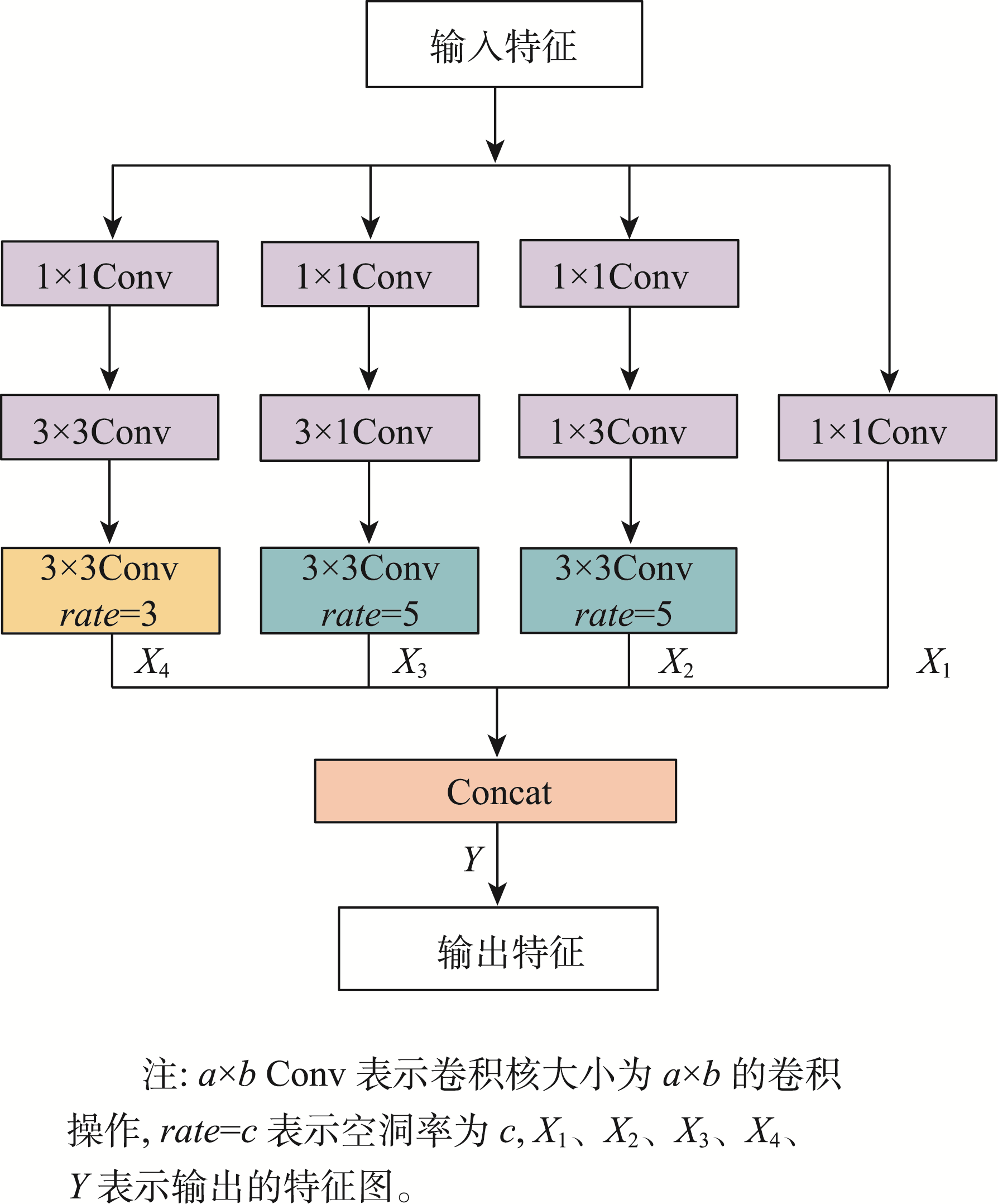

2.2 特征增强模块

实现目标检测主要通过使用主干网络提取的不同尺度的特征图,这些特征图中包含丰富的目标的形状、位置等信息,但是由于主干网络提取的特征有限,语义信息较少,感受野受限,故不能满足高精度目标检测的需求。

因此本文从RFB原理出发,构建了一种特征增强模块,由不同的卷积和空洞卷积构成的多分支的结构拼接而成,旨在提升网络的感受野以及适应多尺度的目标检测。

图4 特征增强模块

模块结构

- 共存在4条分支

- 4条支路分别通过1×1卷积

- 其中一条为残差结构

- 其余3条分别通过3×3、3×1和1×3卷积

- 3条支路分别做空洞率为3、5和5的空洞卷积操作

- 最后将4条支路提取的特征进行拼接

计算过程

X₁ = f₁×₁conv[F]

X₂ = f₃×₃d=5{f₁×₃conv[f₁×₁conv(F)]}

X₃ = f₃×₃d=5{f₃×₁conv[f₁×₁conv(F)]}

X₄ = f₃×₃d=3{f₃×₃conv[f₁×₁conv(F)]}

Y = Cat(X₁, X₂, X₃, X₄)

2.3 结合特征增强的多尺度特征融合结构

SSDD和HRSID数据集具有大场景下的小目标的特点,小目标尺寸大多集中10~30像素值左右,少数在10像素以内,由于合成孔径雷达的特殊成像机制,以及目标易受到噪声等因素的干扰,因此SAR影像上的小型船舶不易与其他目标区分。

对于SAR的小目标来说,随着卷积神经网络的不断加深,对目标的表征能力也在不断减弱,甚至消失。因此本文构建了一种多尺度特征融合的结构,提升对小目标的检测能力。

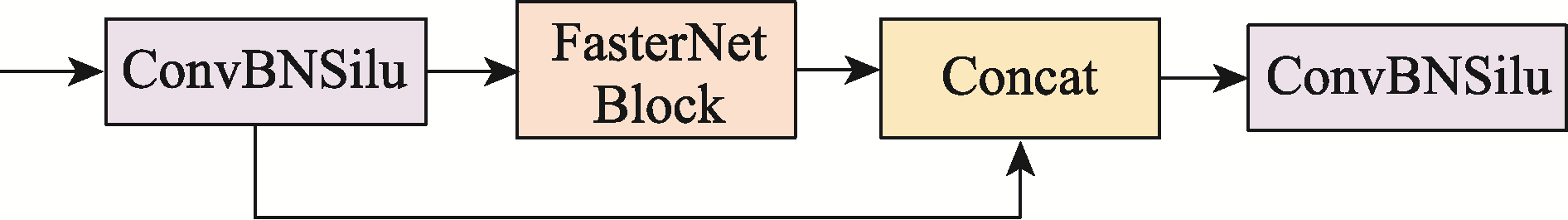

图5 FBFM结构

特征融合流程

- 使用经过注意力处理后的特征图F₁(160×160)、F₂(80×80)以及SPPF模块处理后的特征图F₃(40×40)作为输入

- 对特征图F₃进行特征增强处理,上采样至尺度与特征图F₂相同,并且与之融合

- 经过FBFM处理,得到特征图F'₃

- 再进行特征增强,增强后与特征图F₁融合

- FBFM处理后得到特征图F'₂

- 在F'₂的基础上特征增强,增强后与特征图F'₃融合

- FBFM处理后得到特征图F'₁

- 继续重复上述过程,与特征图F₃融合,得到特征图F₄

计算过程

F'₃ = FBFM{Cat[FE(fup(F₃)), F₂]}

F'₂ = FBFM{Cat[FE(fup(F'₃)), F₁]}

F'₁ = FBFM{Cat[FE(fdown(F'₂)), F'₃]}

F₄ = FBFM{Cat[FE(fdown(F'₁)), F'₃]}

其中FBFM表示经过FasterNet Block Fusion的运算,Cat表示特征图拼接,FE表示特征增强,fup表示上采样,fdown表示下采样

实验结果与分析

3.1 数据集和实验设置

本文分别使用SSDD数据集和HRSID数据集进行训练和测试。

SSDD数据集

- 来自Radarsat-2、TerraSAR-X和Sentinel-1卫星影像

- 1,160个图像和2,456个舰船

- 平均每个图像有2.12个舰船

- 图像尺寸约500×500像素

- 分辨率1~15米

HRSID数据集

- 来自Sentinel-1和TerraSAR-X卫星影像

- 5,604张高分辨率SAR图像

- 16,951个舰船

- 分辨率分别为0.5、1、3米

实验配置

- 数据集划分比例:训练集70%、验证集20%、测试集10%

- 数据增强:Mosaic、Copy paste、翻转和MixUp

- 初始学习率:0.01

- 优化器:SGD

- 动量参数:0.937

- 训练批次:300

- 采用Early Stopping方法优化训练

评价指标

查准率P

TP/(TP+FP)×100%

召回率R

TP/(TP+FN)×100%

平均准确率mAP

ʃ₀¹P(R)dR×100%

3.2 消融实验结果

为了验证本文算法每个改进模块的有效性,分别在SSDD数据集上进行评估。

表1 算法各模块检测精度的评估结果

| 方法 | 更换主干 | CBAM | FEM&MFF | P/% | R/% | mAP/% |

|---|---|---|---|---|---|---|

| Yolov5s | × | × | × | 94.7 | 94.1 | 96.7 |

| 改进1 | √ | × | × | 96.0 | 93.9 | 97.1 |

| 改进2 | √ | √ | × | 96.6 | 90.4 | 97.6 |

| 本文方法 | √ | √ | √ | 96.0 | 95.1 | 98.3 |

评估结果表明,在更换轻量级主干网络后,模型大小明显降低,增加注意力和结合特征增强的融合结构后,模型大小和网络参数量在一定程度上增加,但是在查准率和平均准确率均有所增高。

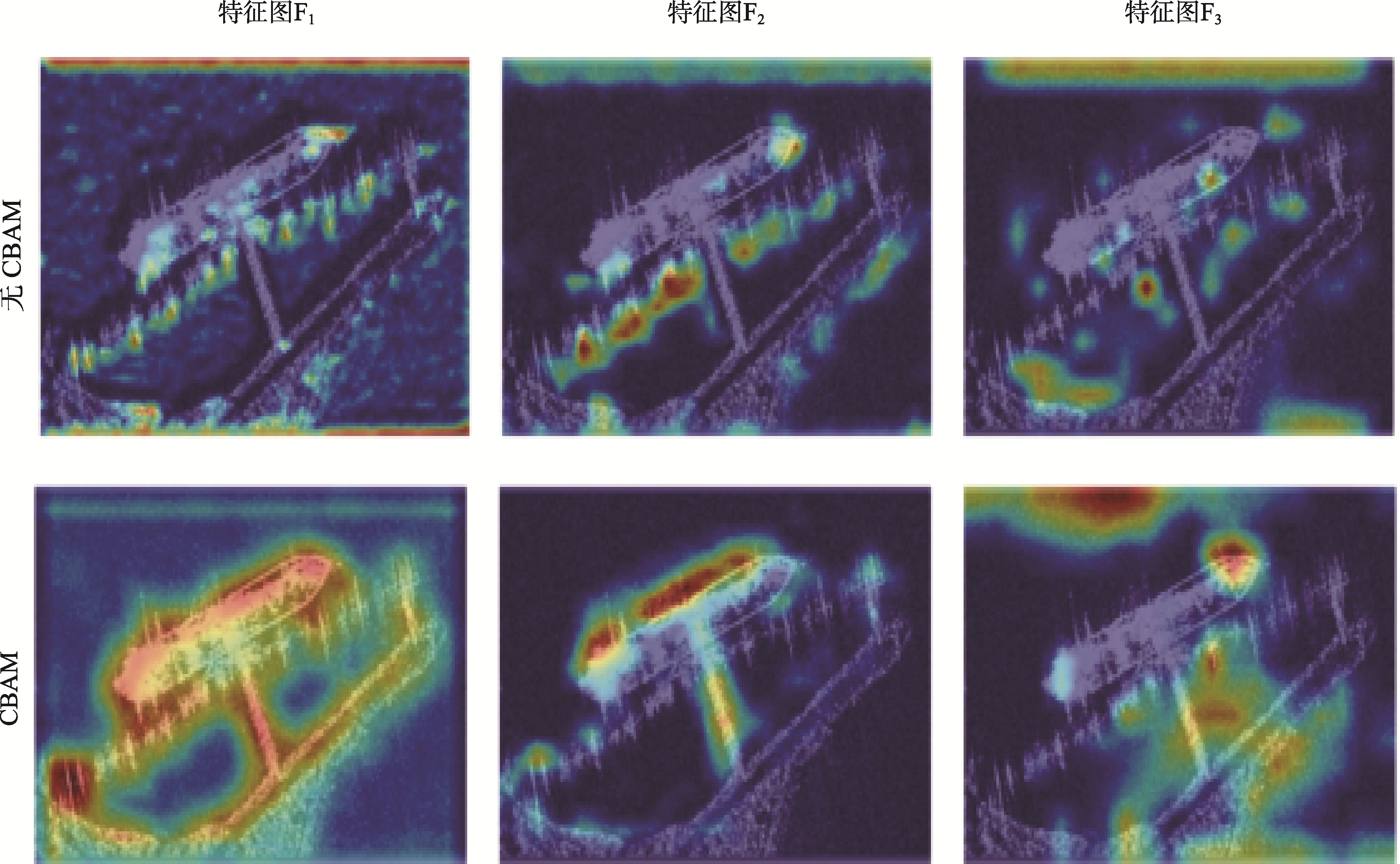

图6 本文算法分别在特征提取阶段输入的3个特征热力图中验证CBAM的重要性

如图6所示,采用Grad-CAM方法分别对有注意力和无注意力输出的3条高低级特征热力图进行可视化分析,明显看出,增加CBAM能够凸显目标的重要性;然后经过结合特征增强的特征融合模块,在增加了部分参数的情况下提高检测精度。

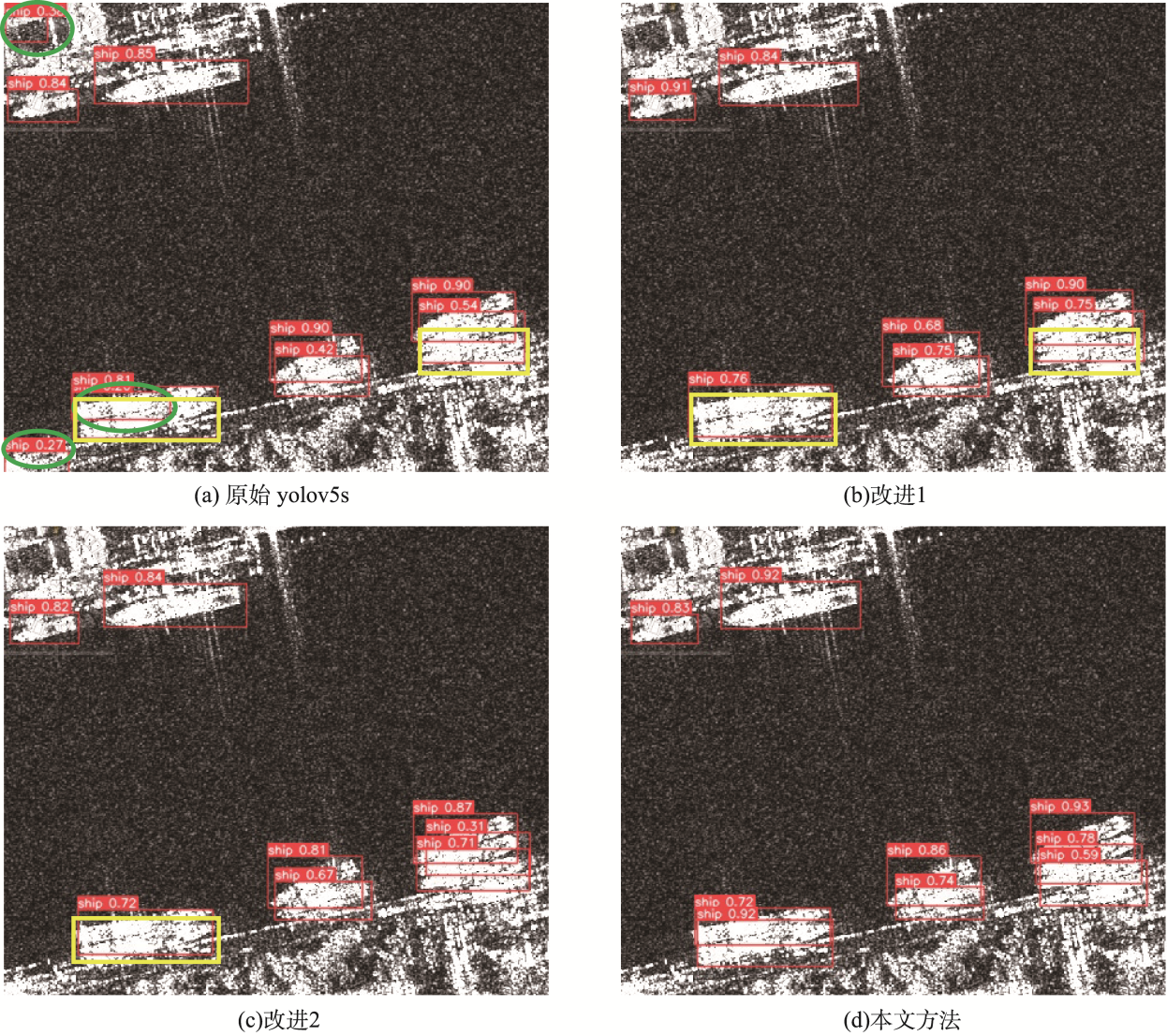

图7 本文算法在SSDD数据集上的消融实验结果

3.3 对比实验结果

分别在SSDD和HRSID数据集,与其他经典目标检测算法Faster r-cnn、SSD、Yolv5s、Yolov7-tiny、YOLOv4-LITE-MR、EfficientYOLO在检测精度和模型大小方面进行对比。

表2 本文算法与其他算法在SSDD数据集性能对比结果

| 算法 | P/% | R/% | mAP/% | Model Size/MB | Parameters/M | FPS/(frams/s) |

|---|---|---|---|---|---|---|

| Faster r-cnn | 84.9 | 76.5 | 85.1 | 108.1 | 41.1 | 31.4 |

| SSD | 86.0 | 70.0 | 86.8 | 90.6 | 23.6 | 59.1 |

| Yolv5s | 94.7 | 94.1 | 96.7 | 14.5 | 7.0 | 37.3 |

| Yolov7-tiny | 95.7 | 92.1 | 97.6 | 12.3 | 6.2 | 24.0 |

| YOLOv4-LITE | 94.0 | 92.6 | 95.0 | 49.3 | - | 47.2 |

| EfficientYOLO | 96.1 | 85.7 | 93.6 | 31.3 | 8.2 | 68.5 |

| 本文算法 | 96.0 | 95.1 | 98.3 | 8.8 | 4.2 | 44.2 |

本文选取在SSDD和HRSID数据集中船舶海岸停靠和海面行驶的6个场景,对Faster r-cnn、SSD、Yolv5s、Yolov7-tiny以及本文改进算法的检测结果与真实标注对比。

检测结果分析

- Faster r-cnn、Yolov7-tiny对于复杂的海岸场景,难以区分船舶与陆地或海边设施,存在大量误检结果

- SSD则是对于近海岸和海面上尺寸较小的目标难以进行有效的识别和定位,造成大量漏检现象

- Yolv5s均检测出大多数在近海岸和海面上的目标,但是由于特征提取能力受限,对于一些船舶密集的近海岸场景不能够取得良好的检测效果

- 相比于其他算法,本文改进的算法能够有效的检测出近海岸和海面上的船舶,尤其在船舶密集分布以及船舶在靠岸与地面物体难以区分的场景下,也能有效地区分目标,降低漏检率

结论与讨论

4.1 结论

本文针对SAR影像船舶多尺度性、特征不够明显和易受噪声干扰等问题,提出了一种复杂背景下的轻量级SAR影像目标检测算法。

- 采用了FasterNet结合CBAM注意力机制的方法作为主干网络,保持轻量化和运行速度快的特点

- 构建特征增强模块来加强模型的特征提取能力

- 结合残差的思想,构建FBFM模块,减少特征提取复杂计算同时提高目标检测准确率

- 在特征融合阶段,将主干网络提取的不同尺度特征进行增强以及多个卷积层、FBFM模块的融合处理

实验结果

- SSDD数据集:mAP 98.3%,召回率95.10%

- HRSID数据集:mAP 92.3%,召回率85.1%

- 合并数据集:mAP 93.0%,召回率86.8%

- 模型大小:8.8 MB,参数量:4.2 M

4.2 讨论

当前SAR影像目标检测算法大多集中在提升检测精度和模型压缩中的一方面,很少方法可以同时兼顾二者。

现有方法局限

- 加深或加宽网络结构导致计算量增长,无法达到实时检测和节省内存的需求

- 追求减少网络参数而损失检测性能,使得网络难以应用于实际

本文提出了一种轻量级卷积神经网络框架,可用于复杂环境下的SAR影像船舶的识别和定位。

未来工作

尽管本文方法的漏检率和误检率较低,但是其漏检和误检仍然存在,因此在未来工作中将继续探索相应的解决方案。