研究背景

技术挑战

- 高分辨率遥感影像处理计算成本高昂

- 局部块间特征交互能力不足

- 上下文先验知识利用不充分

应用价值

- 城市规划与土地利用分析

- 农业资源监测与管理

- 地理空间信息提取

技术方法

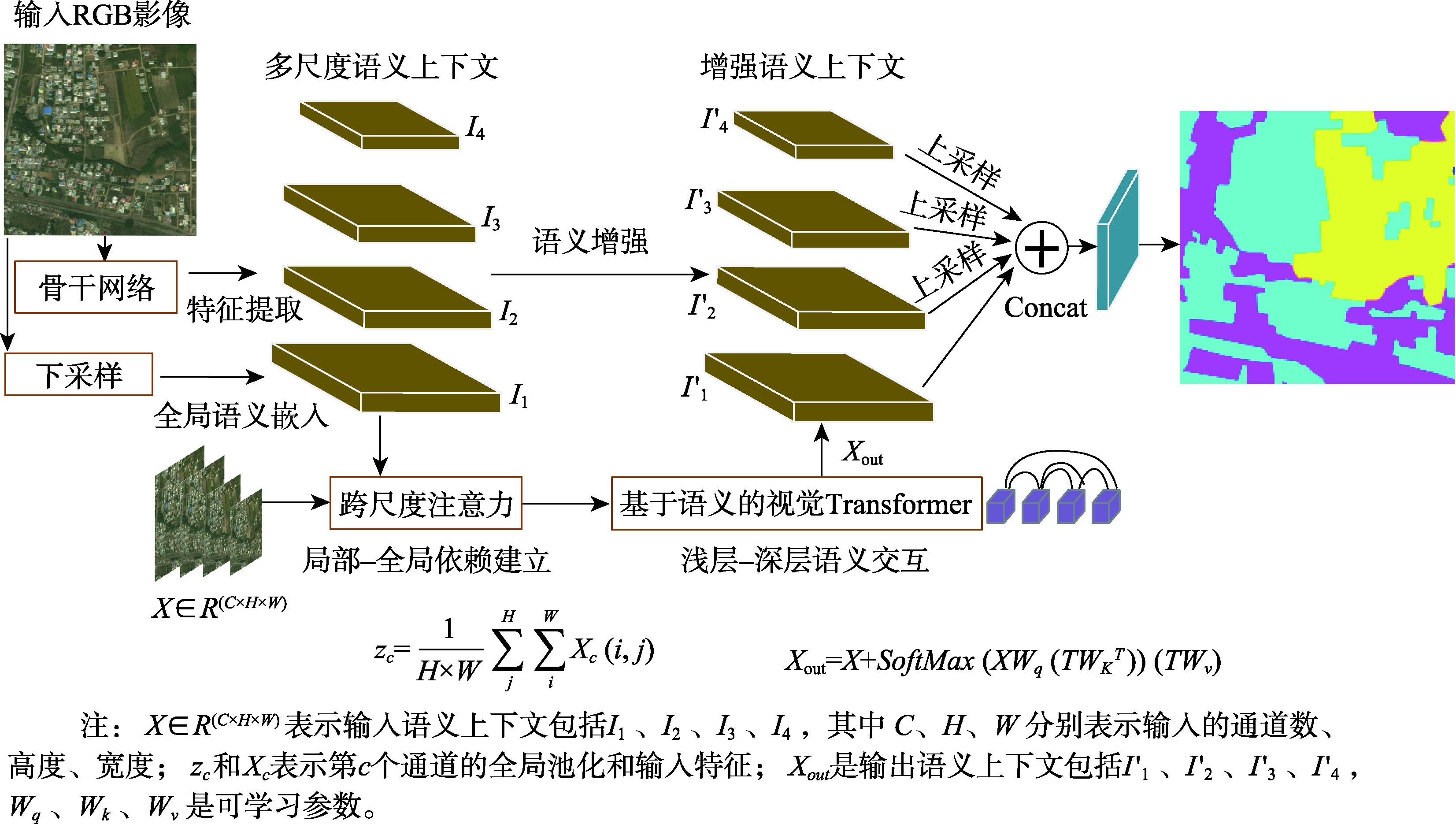

CATrans整体框架

跨尺度注意力模块

- • 并行处理空间高度、宽度和通道维度

- • 分析浅层-深层特征依赖关系

- • 提升不同粒度对象的注意力

- • 避免深度堆叠和多重顺序处理

语义视觉Transformer

- • 耦合多级上下文语义信息

- • 空间注意力增强语义表示

- • 自注意力机制捕获位置依赖

- • 生成增强的上下文语义

实验数据集

DeepGlobe

803张影像

2448×2448像素

50cm分辨率

7个土地覆盖类别

Inria Aerial

180张影像

5000×5000像素

30cm分辨率

建筑物分割

LoveDA

2600张影像

1024×1024像素

30cm分辨率

城乡场景分割

性能表现

76.2%

DeepGlobe mIoU

79.2%

Inria Aerial mIoU

54.2%

LoveDA mIoU

DeepGlobe数据集性能对比

| 方法 | mIoU | mF1 | FPS | 内存(MB) |

|---|---|---|---|---|

| U-Net | 38.4 | 50.1 | 3.5 | 5507 |

| WSDNet | 74.1 | 85.2 | 30.3 | 1876 |

| CATrans | 76.2 | 86.5 | 38.1 | 1256 |

核心创新

跨尺度注意力机制

通过多分支并行结构,有效整合不同尺度的语义信息,提升模型对多粒度对象的识别能力。

语义视觉Transformer

采用自注意力机制捕获上下文依赖关系,生成更清晰的局部特征表示。

上下文先验知识融合

引入全局上下文信息辅助局部块分析,增强特征交互能力。

高效计算架构

实现精度与效率的平衡,在保持高分割性能的同时显著提升推理速度。

消融实验

LoveDA数据集消融实验结果

| 跨尺度注意力 | 语义视觉Transformer | mIoU | 提升 |

|---|---|---|---|

| ❌ | ❌ | 48.5% | 基准 |

| ✅ | ❌ | 49.9% | +1.4% |

| ❌ | ✅ | 50.2% | +1.7% |

| ✅ | ✅ | 54.2% | +5.7% |

研究结论

性能优势

CATrans在三个主流数据集上均取得显著性能提升,相较于最佳对比方法WSDNet, 在mIoU指标上分别提升2.1%、4.0%、5.3%,在mF1指标上分别提升1.3%、1.8%、5.6%。

效率提升

在保持高精度的同时显著提升推理速度,在DeepGlobe、Inria Aerial和LoveDA数据集上 分别达到38.1 FPS、13.2 FPS和95.22 FPS,内存占用大幅降低。

应用价值

该方法在城市建筑、农田、草地等多种地物类型的分割中表现优异, 为城市规划、土地利用分析和地理空间信息提取提供了有效的技术支撑。